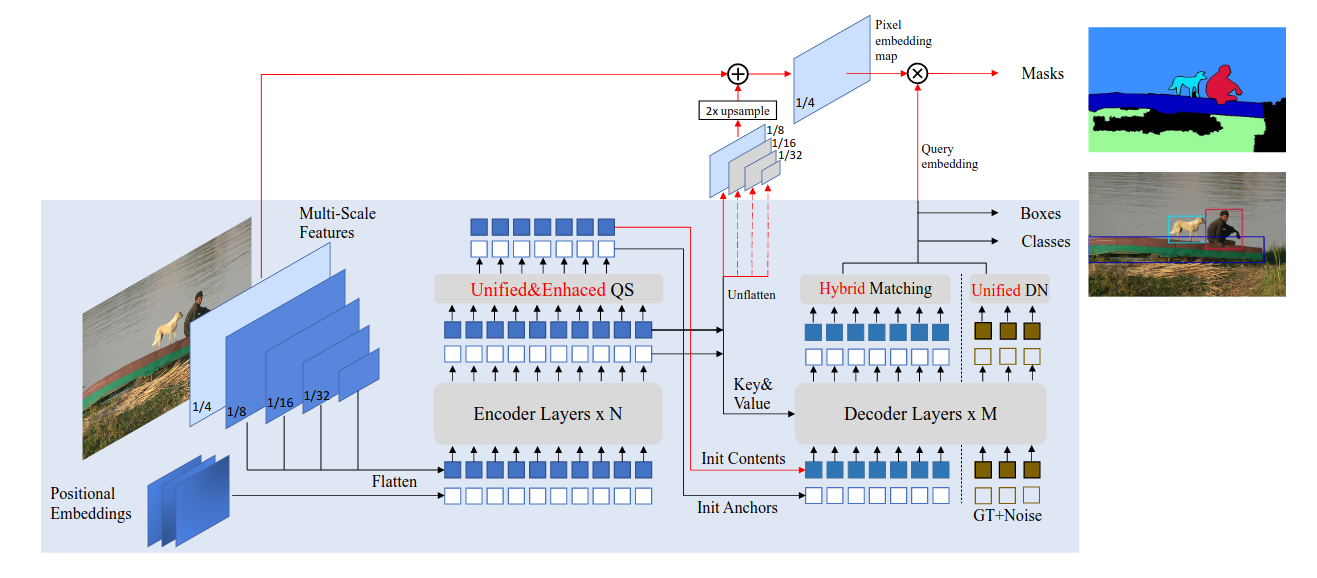

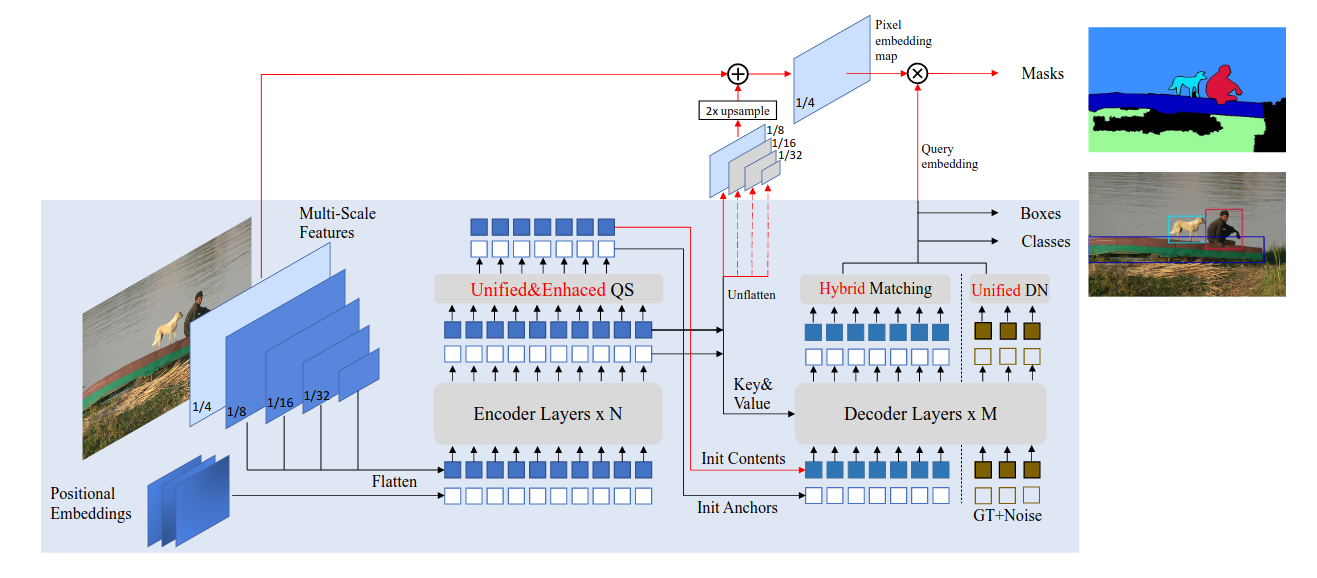

注:此DINO并非自蒸馏自监督的那个[[DINO]],而是派生自[[DETR]]

注:此DINO并非自蒸馏自监督的那个[[DINO]],而是派生自[[DETR]]

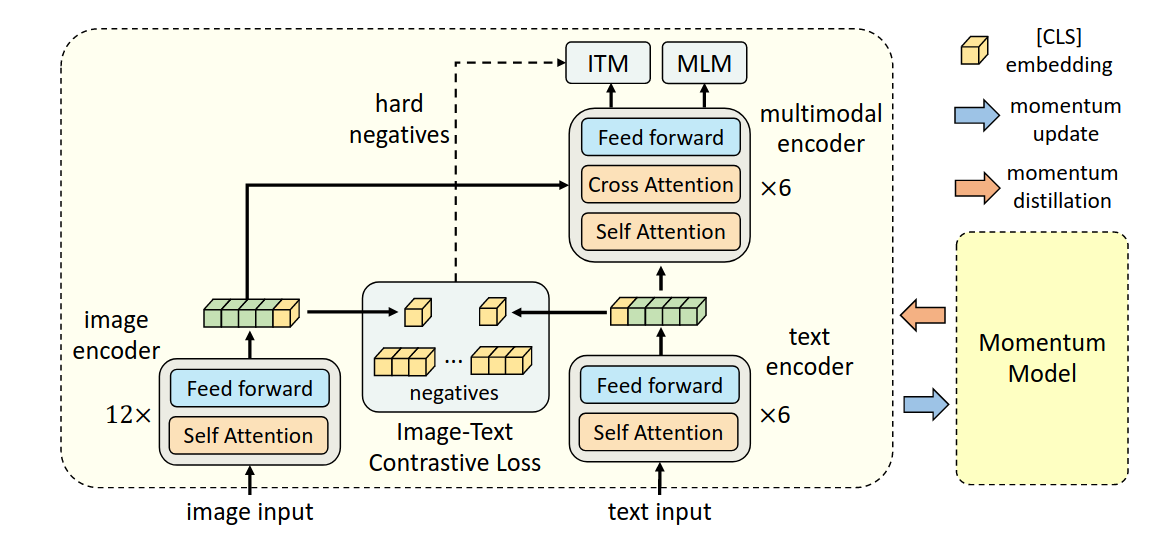

使用的backbone是BERT(通过MLM训练)

该研究认为,image encoder的模型大小应该大于text encoder,所以在text encoder这里,只使用六层self attention来提取特征,剩余六层cross attention用于multi-modal encoder。

A vision-language model that unifies vision-language understanding and generation tasks.

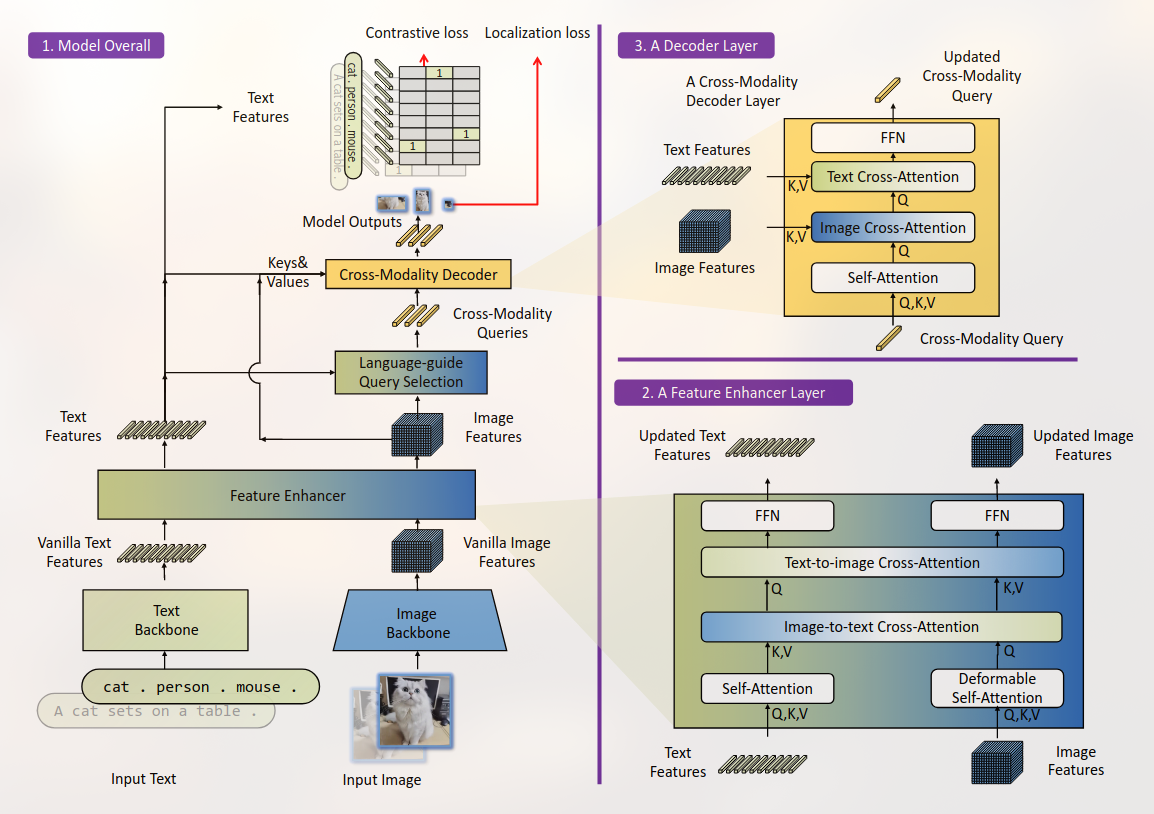

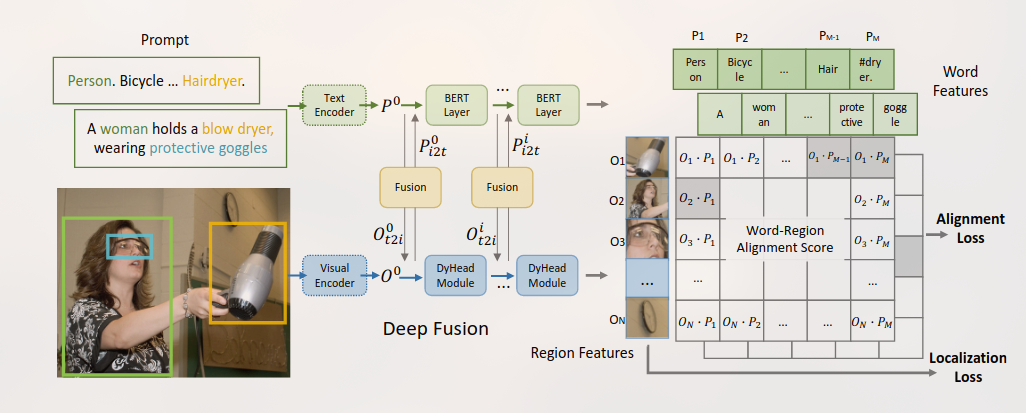

GLIP是一个学习了object-level, language-aware, and semantic-rich visual representations 的模型。

统一对象检测和短语接地进行预训练。

将不同帧$X_t$中的特征集合在M中特征点的公式:

https://github.com/IDEA-Research/Grounded-Segment-Anything

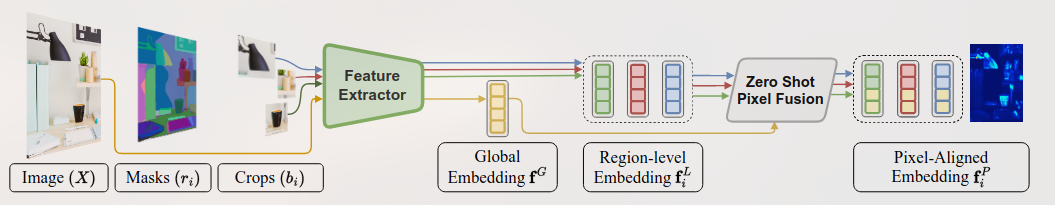

By [[Grounding-DINO]] + SAM

Achieving Open-Vocab. Det & Seg