MotionGPT3 - Human Motion as a Second Modality

研究背景

文本(Text)是离散符号,动作(Motion)是连续信号,两者性质截然不同。现有方法面临两个核心矛盾:

- 量化误差(Quantization Error):将动作离散化为 VQ 码本索引以适配 LLM 的 next-token prediction,会引入近似误差,衰减高频细节,破坏语义-物理一致性

- 跨模态干扰(Cross-Modal Interference):在单流(Single-Stream)骨架中混合文本与动作 token,梯度相互拉扯,导致训练不稳定、收敛慢

研究目标

提出一个统一的动作-语言模型,同时支持:

- Text-to-Motion(T2M):文本描述 → 生成动作

- Motion-to-Text(M2T):动作序列 → 生成文本描述

且需要避免量化误差,减少跨模态干扰。

核心概念

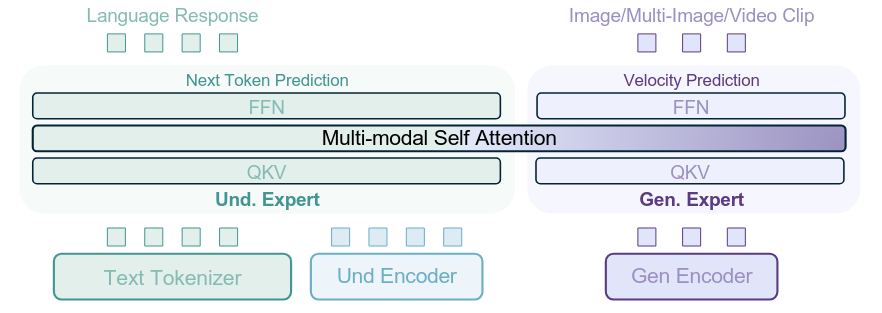

Mixture-of-Transformers(MoT)

来自 Liang et al. (2024) 的思想:为每个模态配备独立的 Transformer 分支,各自拥有独立的 Embedding、FFN 和 LayerNorm,仅在 Self-Attention 层共享。这样:

- 各模态保留自身的归纳偏置(Inductive Bias)

- 跨模态信息仅通过 Attention 受控交换

- 新增模态只需新增分支,无需重训全部参数

连续动作表示(Continuous Motion Representation)

使用预训练的 Motion VAE 将动作编码为连续 latent 向量(而非 VQ 离散索引),避免量化误差。

研究方法

整体架构

1 | Motion VAE Bimodal LLM Motion VAE |

1. Motion VAE

- 来自 Xin et al. (2023)(MLD)

- Encoder $\mathcal{E}$: 将 $N$ 帧动作 $m^{1:N}$ 编码为单个 latent $z \in \mathbb{R}^{256}$

- Decoder $\mathcal{D}$: 将 latent $z$ 解码回动作序列

- 训练目标:重建损失 + KL 正则

- 预训练后冻住,不参与后续训练

- 动作长度信息隐式编码在 latent 中,Decoder 可生成变长输出

2. 双分支 Bimodal Transformer(MoT 架构)

两个并行分支,基于 GPT-2 配置(12 层,维度 768,MLP 维度 3072):

| 组件 | Text Branch $\mathcal{T}$ | Motion Branch $\mathcal{M}$ |

|---|---|---|

| 初始化 | 预训练 GPT-2(124M) | 从零训练(238M) |

| Embedding | 文本 Embedding | 独立 Motion Embedding |

| FFN | 独立 | 独立 |

| LayerNorm | 独立 | 独立 |

| Self-Attention | 共享 | 共享 |

路由机制:硬路由(非学习),由特殊标记决定——

<som>/<eom>界定动作边界<motion_in>/<motion_out>标记 I/O 位置- 文本 token($\vartheta_i = 0$)→ Text Branch

- 动作 token($\vartheta_i = 1$)→ Motion Branch

3. 动作接口模块

由于动作是连续信号,不能复用文本的 Embedding lookup 和 softmax 解码,需要专用接口:

- MUH(Motion Understanding Head):线性投影,将 VAE latent 映射到 Transformer 输入空间(理解任务)

- MGH(Motion Generation Head):即 Diffusion Head $\mathcal{H}$,将 Transformer 隐状态映射回 VAE latent 空间(生成任务)

4. Diffusion Head $\mathcal{H}$

轻量级扩散模型(3 层 MLP + ResBlock,隐藏维度 1024),在 VAE latent 空间中做去噪:

$$\mathcal{L}{\text{diff}} = \mathbb{E}{z_0, t, \epsilon}\left[|\epsilon - \mathcal{H}(z_t, h_m)|_2^2\right]$$

- 训练时:对 $z_0$ 加噪得 $z_t$,$\mathcal{H}$ 以 Motion Branch 隐状态 $h_m$ 为条件,学习预测噪声 $\epsilon$

- 推理时:插入 $K$ 个

<motion_out>占位 token,Motion Branch 输出 $h_m^{v:v+K}$,$\mathcal{H}$ 从纯噪声 $z_T$ 逐步去噪(默认 100 步)得到 $\hat{z}_0$,再由 VAE Decoder 解码

训练策略:三阶段对齐

Stage I: Text-to-Motion 预训练

- 冻住 Text Branch $\mathcal{T}$

- 只训练 Motion Branch $\mathcal{M}$ + Diffusion Head $\mathcal{H}$

- 任务:T2M(文本→动作生成)

- 目的:让 $\mathcal{M}$ 在稳定的语言条件下学会动作语义

- 100k iterations

Stage II: 跨模态对齐(Cross-Modal Alignment)

- 仍冻住 $\mathcal{T}$

- 引入多任务:T2M + M2T + Motion Prediction

- 以指令格式呈现,促进双向对齐

- 300k iterations

Stage III: 联合微调(Joint Fine-Tuning)

- 解冻 $\mathcal{T}$,全参数微调

- 混合文本-动作配对数据 + 纯文本数据

- 50k iterations

主要发现

双流 vs 单流

- 双流架构收敛速度约为单流的 2 倍(训练损失)

- 验证指标(R@3, MMDist)收敛快 4 倍

- 相同损失水平下,双流模型质量更优

连续 VAE vs 离散 VQ

- VQ 方案在 R@3 约 0.5 时即饱和(天花板低)

- VAE 连续表示持续改进,最终质量显著更高

实验结果

在 HumanML3D 上:

- T2M:R@3 = 0.837,MMDist = 2.725,达到 SOTA

- M2T:BertScore = 35.231,超越现有统一模型

讨论

优势

- 避免 VQ 量化误差,保留高频运动细节

- 双分支设计减少梯度干扰,加速收敛

- 三阶段训练抑制跨任务干扰

- 仅需 2 张 3090,训练高效

局限性

- VAE 输出单个 latent,不支持长动作的分段组合生成

- 方向性控制(左/右)有时会失败

- 泛化能力受限于数据覆盖范围

与其他多模态架构的对比

| 架构类型 | 路由方式 | 代表 | 特点 |

|---|---|---|---|

| 单流 + Projector | 无路由,全拼接 | LLaVA, Qwen-VL | 简单,但有跨模态干扰 |

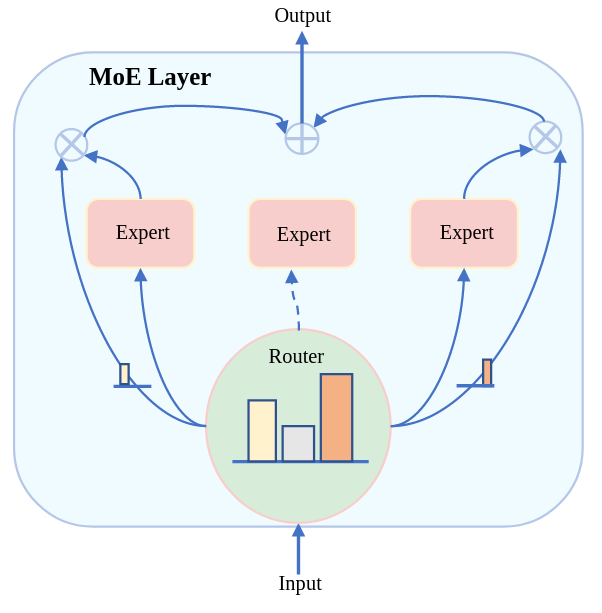

| MoE | 学习的 Router, TopK 选专家 | Mixtral, Switch Transformer | 动态路由,扩展性好 |

| MoT / 双分支 | 按模态硬路由,共享 Attention | MotionGPT3 | 隔离前馈,受控交互 |

未来方向

- 分层/分段 latent:用 hierarchical 或 segment-wise latent 表示支持长动作和组合生成

- 更大数据集和更强 LLM:扩展训练规模,评估效率和鲁棒性

- 局部语义对齐:支持段级别的文本-动作精细对应

参考文献

- Zhu, B., Jiang, B., Wang, S., et al. (2025). MotionGPT3: Human Motion as a Second Modality. arXiv:2506.24086.

- Xin, T., et al. (2023). MLD: Motion Latent Diffusion.

- Liang, C., et al. (2024). Mixture-of-Transformers (MoT).

- Radford, A., et al. (2019). GPT-2.

3D-Scene

Atlas

CLIP

CV

Chemistry

Contrastive-Learning

DINO

DT

Diffusion

DiffusionModel

Embodied-AI

FL

FPN

FoundationModel

Gated-NN

HRI

Hierarchical

HumanoidRobot

Image-Grounding

Image-Text

Image-generation

Image2Text

ImgGen

ImitationLearning

LLM

LatentAction

ML

MoE

MoT

MotionGeneration

MR/AR

Message-Passing

Multi-modal

Multi-view

MultiModal

NLP

NN

Object-Detection

Open-Vocabulary

Panoptic

Physical-Scene

PoseEstimation

QML

Quantum

RL

RNN

Real2Sim

Reconstruct

Representation-Learning

RobotLearning

Robotics

Scalability

Scene-graph

Scene-synthesis

Segmentation

Semantic

Sim2Real

Subgraph

Survey

Task-Planning

Transformer

Translation-Embedding

VAE

VLA

VLM

VLP

VQ-VAE

ViT

Visual-Relation

WorldModel

Unified-Multimodal

LingBot-VLA: A Pragmatic VLA Foundation Model

论文链接 | GitHub | Checkpoints

研究背景

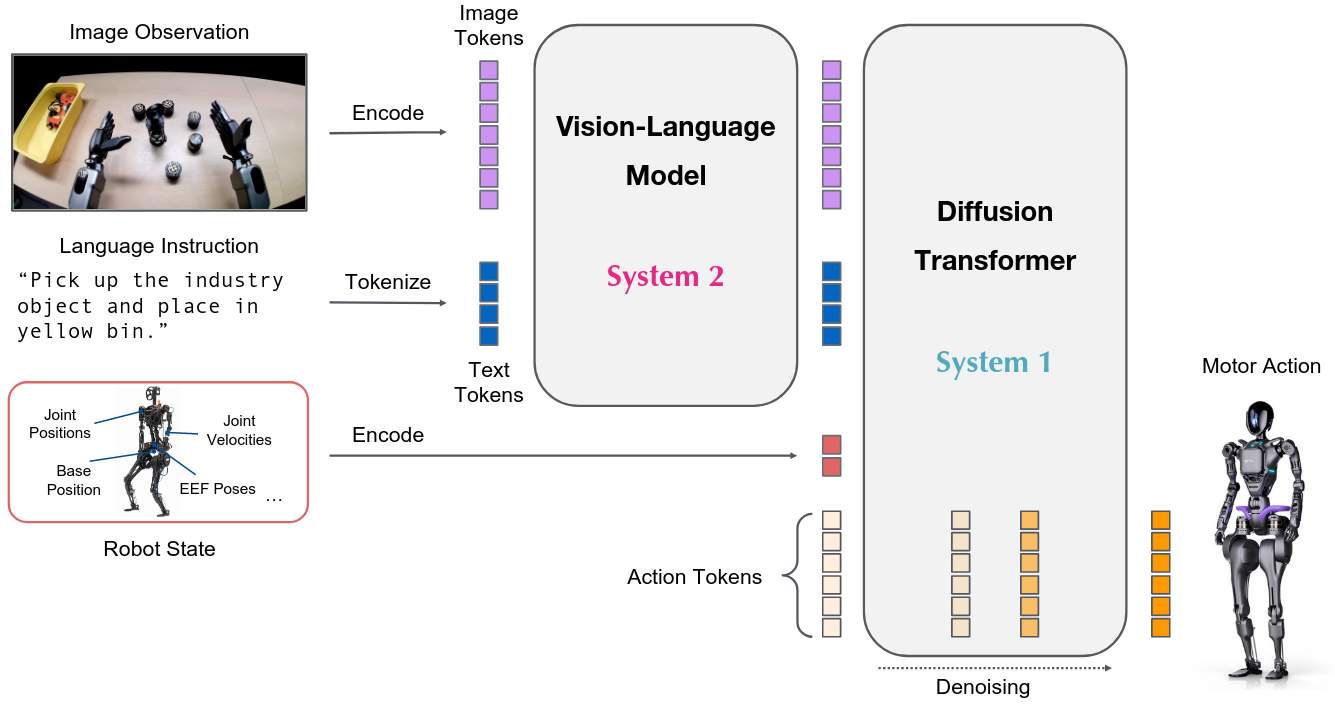

视觉-语言-动作(Vision-Language-Action, VLA)基础模型是机器人操作领域的新兴方法,通过大规模预训练使机器人能够执行由自然语言指令引导的多样化操作任务。然而,目前存在以下问题:

- 缺乏关于真实机器人性能如何随预训练数据规模增长而变化的系统性实证研究

- 缺乏高效的训练代码库来支持大规模数据的扩展评估

- 缺乏跨多平台、多任务的系统性真实世界评估基准

研究目标

- 探索 VLA 模型在真实世界机器人数据上的扩展规律(Scaling Law)

- 建立跨多平台、多任务的系统性真实世界评估基准

- 开发高效的大规模 VLA 训练代码库

核心概念

Mixture-of-Transformers (MoT) 架构

将预训练的视觉语言模型(VLM)与动作生成模块(Action Expert)结合,通过共享自注意力机制实现跨模态统一建模。视觉-语言和动作模态通过独立的 Transformer 路径处理,既保留 VLM 的语义先验,又避免跨模态干扰。

Flow Matching

一种用于连续动作建模的生成方法,通过学习从噪声到目标动作的向量场来生成平滑的机器人控制信号。

Blockwise Causal Attention

将序列划分为图像-指令块、状态块和动作块,应用因果掩码防止信息泄露,确保动作预测只能访问当前和历史观测信息。

研究方法

模型架构

LingBot-VLA 采用 MoT 架构,整合 Qwen2.5-VL 作为视觉语言骨干网络,配合独立的 Action Expert 模块:

联合建模序列:

$$[O_t, A_t] = [I_t^1, I_t^2, I_t^3, T_t, s_t, a_t, a_{t+1}, \ldots, a_{t+T-1}]$$

其中 $I_t^{1,2,3}$ 为三视角图像,$T_t$ 为任务指令,$s_t$ 为机器人状态,$A_t$ 为动作序列(chunk length = 50)。

类似[[BAGEL-Unified-Multimodal-Pretraining]]

Flow Matching 目标函数

定义概率路径通过线性插值:

$$A_{t,s} = sA_t + (1-s)\epsilon, \quad \epsilon \sim \mathcal{N}(0, I)$$

训练目标:

$$\mathcal{L}{FM} = \mathbb{E}{s \sim U[0,1], A_t, \epsilon}|v_\theta(A_{t,s}, O_t, s) - (A_t - \epsilon)|^2$$

深度信息蒸馏

通过可学习查询 $Q_t$ 与 LingBot-Depth 模型的深度 token $D_t$ 对齐,增强空间感知:

$$\mathcal{L}{distill} = \mathbb{E}{Q_t}|Proj(Q_t) - D_t|$$

训练效率优化

- FSDP 分布式策略:采用混合分片数据并行(HSDP),为 Action Expert 模块构建专用分片组

- 算子级优化:使用 FlexAttention 优化稀疏注意力计算,torch.compile 进行算子融合

- 混合精度:reduction 使用 float32,存储和通信使用 bfloat16

主要发现

扩展规律验证

- 预训练数据从 3,000 小时扩展到 20,000 小时,下游任务成功率持续显著提升

- 在 20,000 小时数据量下仍未出现饱和迹象,表明 VLA 性能持续受益于数据量增加

- 首次提供了真实世界机器人学习中有利扩展特性的实证证据

数据效率

- 仅使用 80 个演示即可超越 π0.5 使用 130 个演示的性能

- 随着后训练数据量增加,与基线的性能差距进一步扩大

实验设计

预训练数据

- 规模:约 20,000 小时真实世界操作数据

- 来源:9 种双臂机器人平台(AgiBot G1、AgileX、Galaxea R1Lite/R1Pro、Realman Rs-02、Leju KUAVO、Qinglong、ARX Lift2、Bimanual Franka)

评估基准

- GM-100 基准:100 个操作任务,39,000 个专家演示

- 评估规模:3 个机器人平台,每任务 130 个后训练 episode,共 22,500 次试验

- 对比方法:π0.5、GR00T N1.6、WALL-OSS

真实世界评估结果

| 方法 | 平均成功率(SR) | 平均进度分(PS) |

|---|---|---|

| WALL-OSS | 4.05% | 10.35% |

| GR00T N1.6 | 7.59% | 15.99% |

| π0.5 | 13.02% | 27.65% |

| LingBot-VLA w/o depth | 15.74% | 33.69% |

| LingBot-VLA w/ depth | 17.30% | 35.41% |

仿真评估结果(RoboTwin 2.0)

| 方法 | Clean 场景 SR | Randomized 场景 SR |

|---|---|---|

| π0.5 | 82.74% | 76.76% |

| LingBot-VLA w/o depth | 86.50% | 85.34% |

| LingBot-VLA w/ depth | 88.56% | 86.68% |

训练吞吐量

- 实现 261 samples/s/GPU(8-GPU 配置)

- 相比 StarVLA、DexBotic、OpenPI 提升 1.5~2.8 倍

- 在 256 GPU 规模下仍保持接近线性扩展

讨论

优势

- 首次在大规模真实世界数据上验证 VLA 扩展规律

- 显著优于现有 SOTA 方法的多平台泛化能力

- 高效的训练代码库,支持大规模分布式训练

- 开源代码、模型和基准数据

局限性

- 目前仅支持双臂机器人配置

- 评估主要集中在桌面操作任务

- 深度信息蒸馏依赖额外的 LingBot-Depth 模型

相关工作

Foundation VLA

- π0:Vision-language-action flow model for general robot control

- π0.5:VLA model with open-world generalization

- GR00T N1.6:Open foundation model for generalist humanoid robots

Spatial VLA

- SpatialVLA:探索 VLA 模型的空间表示

- Spatial Forcing:通过对齐策略增强 VLA 空间理解

- GeoVLA:赋能 VLA 模型 3D 表示能力

高效训练框架

- OpenPI:支持 JAX 和 PyTorch 的 π 系列模型训练框架

- StarVLA:VLA 和 VLM 联合训练的模块化代码库

- DexBotic:统一高效��� VLA 开发生命周期解决方案

未来方向

- 扩展机器人类型:整合单臂和移动机器人数据,支持更多样化的操作能力

- 非约束环境:探索在非结构化环境中的移动操作能力

- 持续扩展:进一步扩大预训练数据规模,探索扩展规律的上限

参考文献

- Black et al. (2025). π0: A vision-language-action flow model for general robot control. RSS.

- Black et al. (2025). π0.5: A vision-language-action model with open-world generalization. CoRL.

- Bjorck et al. (2025). GR00T N1: An open foundation model for generalist humanoid robots. arXiv.

- Bai et al. (2025). Qwen2.5-VL technical report. arXiv.

- Lipman et al. (2022). Flow matching for generative modeling. arXiv.

- Wang et al. (2026). The Great March 100: 100 detail-oriented tasks for evaluating embodied AI agents.